[Article Review] LightGAN: A Deep Generative Model for Light Field Reconstruction

오늘 리뷰할 논문은 IEEE Access에서 2020년도에 나온 논문으로 IF(2020)는 3.367입니다.

우리가 보는 세상은 3차원이지만 카메라로 찍으면 2차원의 이미지로 변하게 됩니다.

이때, 3차원의 점들이 이미지 상에서 어디에 맺히는지 기하학적으로 생각하면 영상을 찍을 당시 카메라의 위치나 방향에 의해 결정됩니다. 그러나, 카메라 내부 기구적인 부분에 의해 크게 영향을 받기 때문에 3차원 점들이 영상에 투영된 위치를 구하거나 역으로 영상좌표로부터 3차원 공간 좌표를 복원할 때 이러한 내부 요인을 제거해야 합니다.

이런 내부 요인의 파라미터 값을 구하는 과정을 캘리브레이션(calibration)이라고 합니다.

위의 그림 처럼 핀홀 카메라는 이해하기 쉬운 카메라 모델의 예이며 바늘 구멍이 렌즈 중심, 뒷면이 상이 맺히는 곳까지의 거리 카메라 초점거리 입니다.

영상처리 분야에서 영상에 대한 기하학적 해석은 핀홀 카메라를 바탕으로 이해됩니다. 이를 카메라 모델로 자세히 보면 동그라미가 렌즈, 이미지 센서가 상이 맺히는 곳이며 그사이 f가 카메라 초점 거리입니다.

Light field camera 혹은 Plenoptic camera는 2D 영상 센서 평면의 빛의 양을 영상화하는 일반적인 카메라와 달리, 공간 상에서의 여러 방향에서 도달하는 빛의 양, 즉 light field를 분리하여 기록하고 이를 통하여 3차원 깊이의 추정, 임의의 초점에서 초점을 맞춘 영상을 영산하여 생성하는 재초점(refocusing) 기능등을 구현하는 카메라입니다.

이를 위해, 아래 그림처럼 메인 렌즈에 의해서 모아진 및의 양을 마이크로 렌즈 배열(Micro-lens array)을 사용하여 도달하는 방향에 따라 분리되어 기록됩니다.

메인렌즈 평면상의 2D 위치에서 마이크로렌즈 초점 평면상의 2D 위치에 도달한 빛을 기록하므로, 메인렌즈 평면상에서의 2D 위치와 마이크로 렌즈 초점 평면상에서의 2D 위치에 의해 결정되는 4D light field 데이터가 기록됩니다. 이렇게 생성된 4D light field 데이터를 이용하 면 센서 평면이 임의의 위치로 이동된 영상, 즉 가상의 위치에서 초점이 맞은 영상을 4D light field 데이터의 선적분을 통하여 생성해 낼 수 있습니다. 따라서, 4D light field 데이터를 먼저 촬영하고 나중에 임의의 위치에서 초점을 맞춘 영상을 계산을 통하여 얻을 수 있으므로, 초점 여부에 상관없이 영상을 획득한 후 임의의 위치에서 재초점 (refocusing)을 수행하는 기술을 구현할 수 있게 됩니다.

LightGAN: A Deep Generative Model for Light Field Reconstruction

ABSTRACT

Light field camera에 의해 찍힌 이미지는 주어진 공간 내에서 광 분포들의 샘플들로 간주될 수 있습니다. 그러나 센서의 픽셀 수, 즉 센서의 개수가 제한되어 있기 때문에 고해상도 샘플을 획득하면 시차 정보가 손실되는 경우가 많습니다. 본 연구에서는 light field의 분포를 직접 시큘레이션하여 이러한 tradeoff를 극복하기 위한 프레임워크를 제시합니다.

본 연구에서는 제시한 모델에서 중요한 모듈은 시공간 정보를 충분히 활용하는 residual block입니다. 분포를 직접 학습함으로써, sub-aperture 이미지와 조밀하게 샘플링된 light field를 모두 생성할 수 있습니다. 실제 데이터 세트와 만들어진 데이터 세트에 대한 실험 결과는 제안된 방법이 다른 접근 방식보다 월등히 우수하며 시각적으로 더 현실적인 결과를 달성하였습니다.

INTRODUCTION

기존 카메라와 비교하여 라이트 필드 카메라는 실제 공간에서의 명암 값과 방향을 모두 캡쳐할 수 있는 6DOF를 가집니다. 그러나 공간 분해능과 각도 분해능 사이에는 고유한 tradeoff가 있는데 일반적으로 라이트 필드의 공간 분해능은 낮다고 알려져 있습니다.

* 여기서 분해능이란 서로 떨어져 있는 두 물체를 서로 구별할 수 있는 능력으로써 공간은 공간의 차이, 각도는 각도의 차이로 서로를 구별할 수 있는 능력이라 생각하시면 될 것 같습니다.

이러한 light field의 분해능 문제는 일반적으로 기하학 속성의 재구성 이전으로 간주하고 인접한 뷰를 대상 뷰로 왜곡합니다. 그러나 깊이 추정을 위한 접근 방식은 픽셀 왜곡에 대한 정확한 깊이 추정을 제공하는 데 어려움을 겪고 있습니다. 이 과정에서 오류로 인한 찢어짐 및 고스팅과 같은 아티팩트가 발생합니다. 여기서 고스팅은 기체 결함으로 화면에 희미한 이중상이 나타나는 것이고 아티팩트는 없던 것이 영상에서 인위적으로 생기는 것이라고 생각하면 될 것 같습니다.

본 연구에서는 이러한 분해능 문제를 효과적으로 해결하기 위한 모델을 제안합니다. GAN은 높은 인지 품질로 그럴듯해 보이는 자연 이미지를 생성하는 강력한 능력으로 잘 알려져 있습니다. 이러한 이점을 고려하여 고차원 컨볼루션인 HDC 레이어를 GAN 프레임워크에 통합하여 인접한 light field view 간의 높은 상관 관계를 학습합니다.

Methodloghy

본 연구의 궁극적인 목표는 실제 light field 분포를 추정하고 주어진 저해상도 입력에서 고해상도로 대응하는 영상을 생성하는 매핑 기능을 획득하는 것입니다. 아래의 그림은 각 차원에 대한 convolution operation을 보여주고 있습니다. 이과정을 설명하는 이유는 HDC가 4D 공간에서 공간과 각도의 중복성을 완전하게 계산할 수 있는 강력한 성능을 보이기 때문입니다.

HDC 레이어는 재료 인식, 합성 및 초고해상도와 같은 여러 응용 분야에서 사용되어 라이트 필드 이미지를 처리할 수 있는 잠재력을 보여줍니다. 이러한 성과는 각도 상관 관계를 보존하는 공간 표현들을 추출하는 능력에 크게 기인할 수 있습니다. 결과적으로 HDC 레이어를 GAN에 통합함으로써 제안된 모델은 구조 정보를 최대한 활용하여 원래의 라이트 필드 분포를 시뮬레이션할 수 있습니다. 생성기(제너레이터)와 판별기(디스크리미테이터)는 모두 light field data를 4D 공간에서 직접 처리하게 됩니다. 이때 생성기에서 HDRB(high dimensional convolutional residual blocks; 다중 고차원 합성 잔차 블록)을 사용하여 설정됩니다. HDRB는 3x3 angular receptive field가 있는 HDC layer 2개로 구성됩니다. 이러한 구조를 통해 모든 HDRB의 angular receptive field가 5x5 뷰포인트 전체를 커버하여 모듈이 field의 완전한 공간과 각도, 이중화를 학습할 수 있습니다. 나아가 LReLU를 활성화 기능으로 사용합니다. 여기서 LReLU는 기존 ReLU는 함수가 활성화 되지 않을 때 가중치를 조정하지 않기 때문에 기울기가 0이되고 학습 속도가 느려지는데, 이를 완화하고자 개발된 것이 누출 정규화 선형유닛인 LReLu입니다. ReLU와 다르게 ReLU식에서 나오는 음수부분을 상수 0으로 매핑하지 않고 압축하기 때문에 함수가 비활성화 상태여도 1보다 작은 양수값이 출력됩니다. 생성기의 출력은 실제 고해상도 이미지와 함께 학습을 위한 판별기에 전달이 되는데 64에서 512로 증가하는 여러 HDC layer를 포함합니다.

Experiment & Results

이전에서 설명드렸듯, HDC layer는 light field 데이터의 전체 공간 정보를 처리하고 각도 상관관계를 보존하는 기능을 추출할 수 있다고 하였습니다. 이러한 특성을 파악하기 위해 feature map의 공간적 모양과 EPI 패턴을 시각화 한 그림입니다. 가장 왼쪽이 light field camera의 센터뷰에서 본 모습과 학습시킨 영상이고, 오른쪽 3개의 영상들을 각각의 title에서 확인할 수 있는 feature들의 모습과 EPI패턴 입니다. Feature map에서 밝은 영역은 활성도가 높은 위치를 나타내는데, 이는 기하학에서 한쪽 영상의 한점은 다른 라인으로 대응되고 이 라인에 대응될 수 있는 또다른 라인인 Epipolar line으로 이해하시면 될 것 같습니다. 쉽게 말하자면 고차원 특성에서 공통적인 특성이 나타나는 것으로 생각하시면 될 것 같습니다. 이 모든 그림을 한번에 설명드리면 결국 이 그림을 통해 light field 구조 정보를 보존하고 학습된 기능에서 구조 정보를 기억한다는 것을 보여줍니다.

손실함수를 다르게 했을 경우 GT와 어떻게 다른 결과를 내는지에 대한 그림 결과입니다.

S1~S6까지는 table에서 보여주는 setting의 다름을 보여주고 핑크색 화살표는 GT와 다르게 지워지거나 채워져서 다른 영상을 나타냄을 보여줍니다.

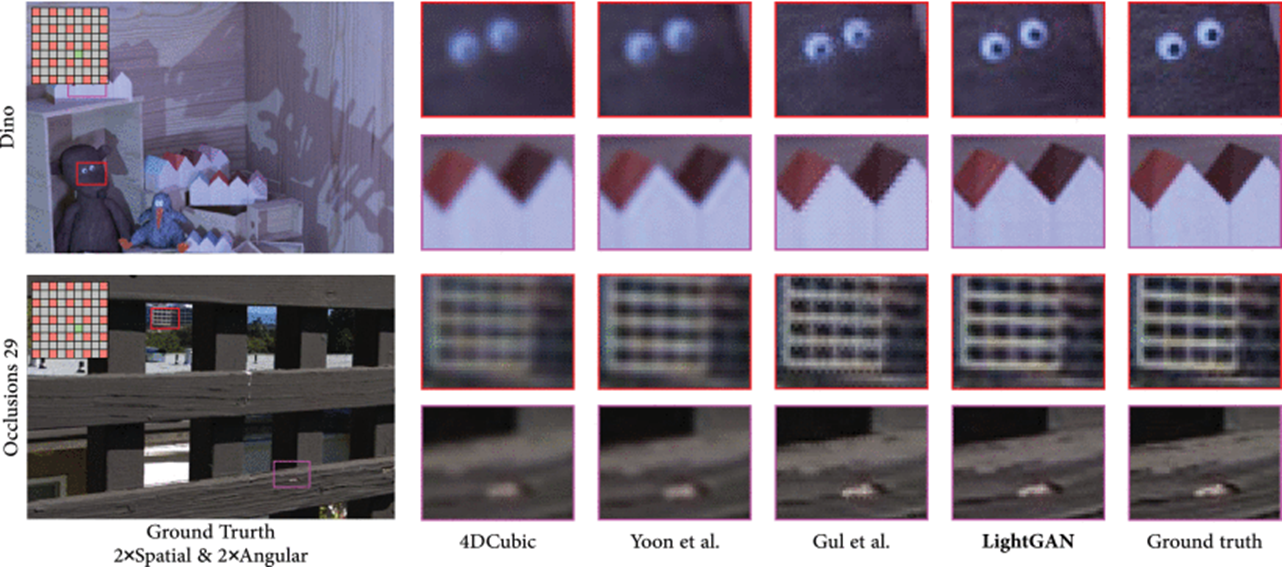

실제 장면에서 한 부분을 떼 왔을때 보간법 혹은 알고리즘과 본 연구의 알고리즘을 비교한 그림결과입니다. 아래의 숫자는 PSNR과 SIMM의 평균 결과이며 높을수록 GT의 해상도와 비슷하다는 것을 나타냅니다.

본 연구와 이전 연구들에서 PSNR 비교 결과표이며, 본 알고리즘이 가장 높은 성능을 보임을 알 수 있습니다.

이해를 돕기위해 PSNR을 간단히 설명하자면, 최대신호대잡음비로써 신호가 가질 수 있는 최대 전력에 대한 잡음의 전력을 나타낸 이론적 배경을 가지고 있으며, 본 연구에서는 MSE(평균제곱오차)가 작을수록 더 큰 PSNR을 갖는 식과 이론을 바탕으로 결론을 내렸습니다. 더 쉽게 설명을 하자면 이미지의 압축을 예로 들 수 있는데, 압축률이 클수록 PSNR이 작아지고 이미지 품질이 나빠진다 라고 이해하시면 될 것 같습니다. 그러나 단순히 원본과 왜곡 이미지 사이의 수치적 차이로 이미지 품질을 평가하기 때문에 사람이 느끼는 것과 일치되지 않은 결과를 산출할 수도 있습니다.

CONCLUSIONS

본 논문에서는 light field 영상의 재구성을 위한 GAN 프레임 워크를 제안했습니다.

공간 및 각도의 중복성들을 완전히 계산하기 위해 생성기와 판별기 모두에 HDC 레이어를 통합하여 네트워크가 저해상도 및 고해상도 light field 간의 직접 매핑을 학습할 수 있도록 하였습니다.

각도 상관 손실과 공간적 지각 손실 및 적대적 손실을 결합하여 제안된 모델은 높은 시각적 정확도로 고주파 공간 세부 정보를 복구할 수 있었습니다.

제안된 프레임워크는 특별히 light field 처리를 위해 설계되었으므로 공간 SR 및 뷰 합성을 포함한 일련의 재구성 문제를 처리할 수 있습니다.

실험 결과에 따르면 본 연구에서 개발한 모델은 공간 또는 각도 해상도를 높이는 것 외에도 local light field 분포를 시뮬레이션 할 수 있으며 대부분의 상황에서 다른 최첨단 알고리즘보다 성능이 뛰어남을 확인했는데, 특히 복잡한 오클루전 및 비 램버시안 표면이 있는 장면에 적용할 때 성능이 뛰어났습니다.

오클루전 : 한 장면의 각 점이 광원에 얼마나 노출되었는지를 계산하기 위해 사용되는 셰이딩 및 렌더링 기법

램버시안 반사율을 갖는 표면 : 관찰자가 바라보는 각도와 관계없이 같은 겉보기 밝기를 갖는 것인데 반짝이는 처리를 한 목재의 경우 광원의 위치와 거울면과 같은 하이라이트를 갖는다. 반사에 대한 개념

비 램버시안 표면은 이러한 거의 반대가 non-램버시안 표면이고 혼성 반사 특성(정반사, 난반사)을 갖음

컴퓨터 그래픽스에서는 난반사가 이루어지는 표면을 묘사하기 위해 램버시안 모델이 사용됨

citation : Meng, N., Ge, Z., Zeng, T., & Lam, E. Y. (2020). LightGAN: A deep generative model for light field reconstruction. IEEE Access, 8, 116052-116063.